taz/dpa | Am vergangenen Sonntag, dem 15. Februar, berichtete das „heute journal“ des ZDF über die gewalttätigen, willkürlichen Abschiebungen der ICE-Behörde in den USA. „Sie führen Eltern vor den Augen ihrer Kinder ab oder nehmen Minderjährige vor ihren Schulen mit“, sagt die Stimme aus dem Off.

Das ist faktisch richtig, doch zeigte das „heute journal“ dazu Bilder einer Mutter in den Händen eines ICE-Agenten, während ihr weinendes Kind sie umarmt. Das Problem: Am oberen und rechten Bildrand steht klar erkennbar das Wasserzeichen Sora.

Dabei handelt es sich um die Video-KI des US-Unternehmens OpenAI, das hinter ChatGPT steht. Das Wasserzeichen entlarvt das Video als KI-generiert und somit als Fälschung. Dass ZDF und „heute journal“ solche Videos für ihre Berichterstattung nutzen – und die Nutzung im Originalbeitrag nicht kennzeichneten – ist ein schwerer Fehler.

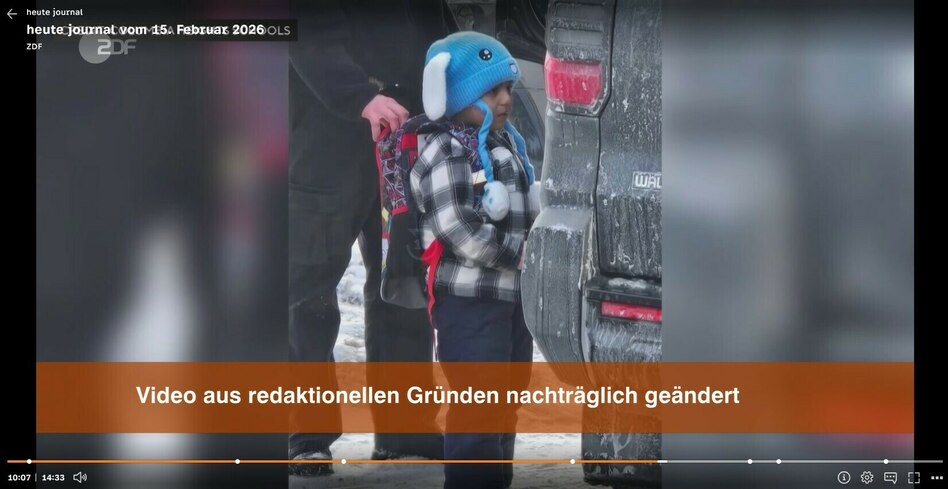

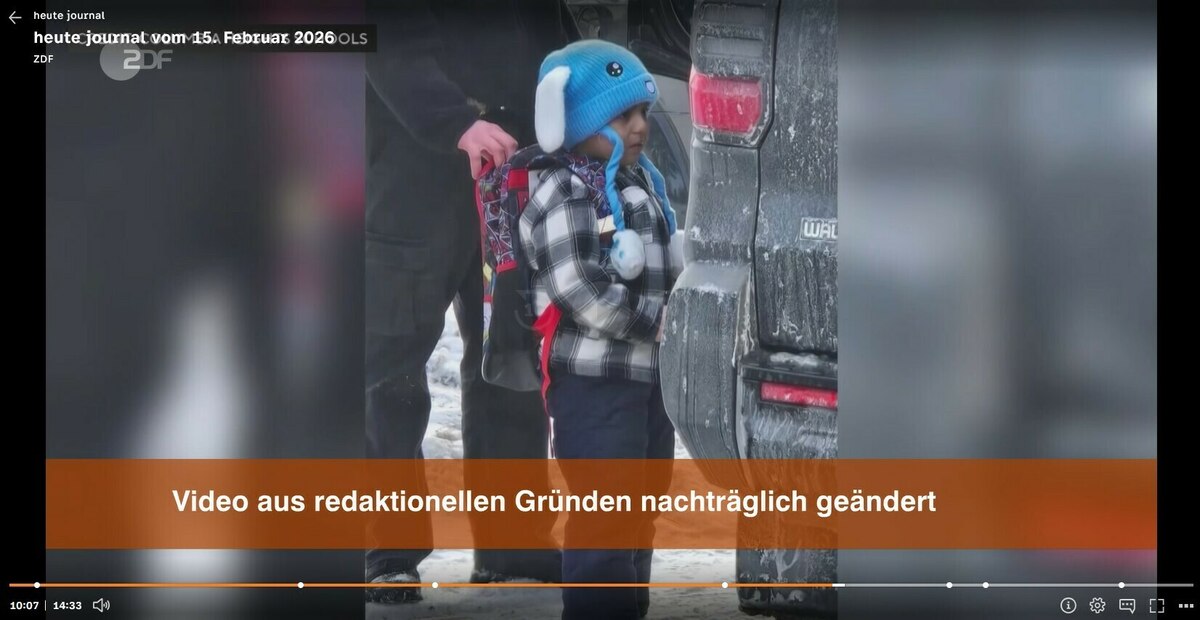

Wie der Sender mit seinem Fehltritt umgeht, macht es nicht besser. Im Anschluss an die Veröffentlichung der Folge wurde zunächst der Zusatz „Video aus redaktionellen Gründen nachträglich geändert“ eingefügt und das KI-Video entfernt. Inzwischen wurde die „heute journal“-Folge vom 15. Februar sowohl aus der ZDF-Mediathek als auch auf dem dazugehörigen YouTube-Kanal vollständig gelöscht.

Zunächst sprach der Sender von einem „technischen Versehen“. Dem Pressedienst epd teilte der Sender mit: „Der Beitrag zeigt, dass sowohl mit echten als auch mit KI-generierten Bildern ein Klima der Angst erzeugt wird.“ Das ZDF bedauere, „dass dabei nicht deutlich genug wurde, welche Bilder real sind und welche nicht“. Am Dienstag erklärte die stellvertretende Chefredakteurin „Der Beitrag entspricht nicht unseren Standards und hätte in dieser Form nicht gesendet werden dürfen.“ Auf taz-Anfrage teilte das ZDF noch mit, dass auf „‚ZDFheute‘ sowie an gleicher Stelle im ‚heute journal‘ diesen Dienstagabend korrigierend berichtet“ werden solle.

Fehlerkultur wäre das Mindeste

Dass KI-generierte Bilder, Stimmen und Videos als solche gekennzeichnet gehören, versteht sich von selbst. Und auch wenn es in der Recherche und dem Faktencheck nicht passieren sollte, kann es in der zunehmenden Flut von KI-Inhalten durchaus sein, dass etwas davon seinen Weg in die finale Sendung schafft. Ein transparenter Umgang mit einem solchen Fehler wäre allerdings das Mindeste. Dazu würde etwa gehören, zu erklären, wie der Fehler entstehen konnte.

Dieser Fehltritt eines öffentlich-rechtlichen Senders sind natürlich ein Anlass für rechte Medien gegen den ÖRR Stimmung zu machen. So spricht die Junge Freiheit von Manipulation und diskreditiert die Moderatorin Dunja Hayali gleich mit.

Die Kritik ist überzogen und auf Moderatorin Hayali zugespitzt. Rechte nehmen den Moment auch zum Anlass, um das brutale Vorgehen der US-Einwanderungsbehörde ICE zu legitimieren. Dafür kann das ZDF nichts, solche Anlässe werden von Rechten immer wieder gefunden. Aber das ändert nichts an der Tatsache, dass bei Kenntnissen über KI-Inhalte, korrekter Recherche und Endabnahme sowie einem professionellen Krisenmanagement beim „heute journal“ etwas nicht stimmt.

Der ÖRR muss Seriosität und Faktentreue bieten, verletzt in diesem Fall aber seine eigenen Standards. Noch dazu bedienen solche Fehler das trumpsche Narrativ der Fake News und schädigen das Vertrauen in den Journalismus allgemein. Um das zu verhindern, muss das „heute journal“ nicht nur genauer, sondern auch transparenter arbeiten.